Le funzioni più comunemente utilizzate per calcolare la distanza tra embeddings (vettori numerici che rappresentano dati come testo, immagini, ecc.) sono:

- Similarità Coseno (Cosine Similarity): misura l’angolo tra due vettori nello spazio, calcolata come il prodotto scalare normalizzato. Valori prossimi a 1 indicano alta similarità. La distanza coseno è spesso usata come 1 – similarità coseno per dare una misura di distanza.

- Distanza Euclidea: misura la distanza lineare “in linea d’aria” tra due punti (vettori), calcolata come la radice quadrata della somma delle differenze al quadrato delle coordinate. Valori piccoli indicano alta similarità.

- Prodotto scalare (Dot Product): somma dei prodotti delle componenti corrispondenti di due vettori. Utilizzato soprattutto su vettori normalizzati, dove riflette similarità.

Queste funzioni vengono scelte in base a se i vettori embedding siano normalizzati o meno, e a seconda delle caratteristiche del modello che ha generato gli embedding. Ad esempio, per vettori normalizzati, il prodotto scalare (dot product) è molto efficiente; per vettori non normalizzati si preferiscono cosine distance o euclidean distance.

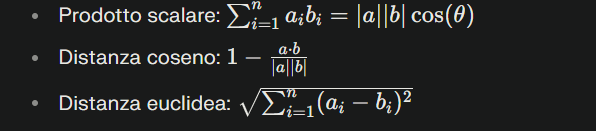

Ecco le formule principali:

Queste misure sono fondamentali per confrontare embeddings in applicazioni di NLP, ricerca semantica e AI in generale, poiché quantificano la somiglianza o la distanza tra parole, documenti o immagini rappresentati come vettori.